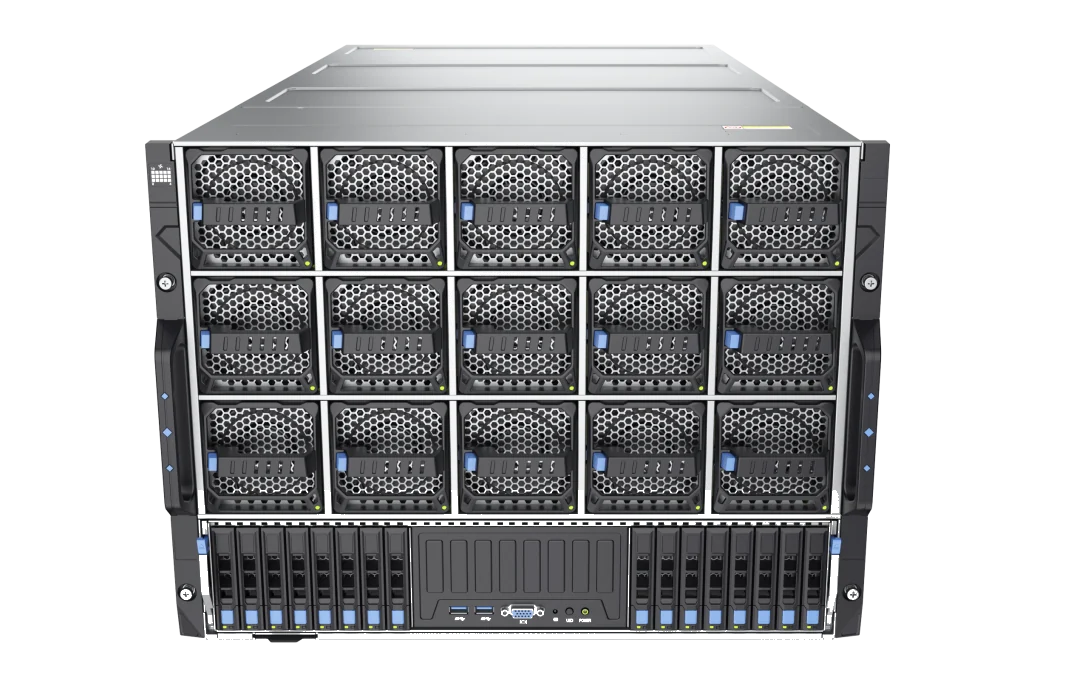

OAM / HGX 高互联 AI 训练服务器,机箱形态按 GPU 平台和项目方案确认

OAM / HGX 高互联 AI 训练服务器,机箱形态按 GPU 平台和项目方案确认硬件结构与交付视图

把主图、后部接口和内部风道放在同一处确认,帮助采购判断上架、扩展、供电、散热和交付边界。

01

01用于确认训练节点的 GPU 密度、上架形态和项目交付外观。

重点确认模型规模、显存、CUDA 环境和训练数据路径。 02

02后部视图用于确认高速网络、管理接口、电源冗余和集群走线。

训练平台需确认 100/200/400GbE 或 IB、NCCL 和机柜 PDU。 03

03内部视图帮助判断训练 GPU 的风道、满载散热和长期运行稳定性。

交付前建议固化驱动、CUDA、容器镜像和训练样例测试。图片用于说明平台结构和配置方向,不替代最终料号。实际接口、GPU 型号、盘位、电源和风道以报价单、供应情况和项目确认表为准。

是否适合这个型号

先判断工作负载和交付环境,再进入具体配置和报价。

高端训练、多机扩展、科研平台和模型公司项目。

如果没有明确训练框架、互联需求和预算边界,不建议直接进入 T8X。

T 系列先解决训练环境和互联效率

适合模型训练、微调、科研实验和多用户 AI 平台;重点看 CUDA/NCCL、数据管线、高速网络、调度和满载验证。

如果主要做推理、转码、GPU 渲染或 CAE 加速,不需要训练级互联和训练软件栈,G 系列通常更经济、更直接。

报价时优先确认训练样例、网络拓扑、数据路径和交付验收项。

适合以下场景

需要 NVLink/NVSwitch 或 HGX 方向的高互联训练

多机扩展、NCCL 通信和科研训练平台

客户愿意以真实训练任务定义验收指标

这些情况建议换产品线

普通 4/8 GPU 训练节点即可满足的项目

推理、渲染或转码为主的 GPU 负载

现场供电、制冷、网络和预算尚未明确

必须先确认的条件

GPU 互联路线和供应周期

NCCL/IB/集群拓扑

训练数据与共享存储

机房供电、制冷和验收样例

核心是通信效率,而不只是 GPU 数量。

要把网络、存储和调度同时纳入方案。

适合以项目制方式做软件栈和验收。

配置决策顺序

先把采购边界讲清楚,再进入具体料号和报价,避免只看单个参数导致选型偏差。

先判断是否需要项目制

项目制高互联 AI 训练服务器 / 高端训练 / 多机扩展 / 科研平台

项目制型号需要真实负载、交付环境和满载边界一起确认再确认计算瓶颈

项目制高互联训练主机平台 / 8x OAM / HGX H200 / B200 级高互联 GPU,按项目确认

确认软件能否利用高核心、多 GPU 或特殊拓扑锁定数据与扩展

2TB+ ECC / 高速 NVMe + InfiniBand / 集群存储

围绕项目文件、缓存、结果数据和后续扩展确认最后确认交付环境

OAM / HGX 高互联 AI 训练服务器,机箱形态按 GPU 平台和项目方案确认 / 项目评估后确认

供电、散热、噪声、测试项和交付周期必须提前锁定CPU

- 高互联训练主机平台

- HGX 主机平台

- 按项目确认 CPU 版本

GPU

- OAM GPU 项目确认

- HGX H200 项目确认

- HGX B200 项目确认

- NVLink / NVSwitch 拓扑确认

MEMORY

- 2TB+ ECC

STORAGE

- 高速 NVMe

- InfiniBand

- 集群存储接入

推荐配置档

项目制型号先看评估路径和交付边界,以下不是固定 SKU,而是方案沟通时的配置方向。

评估档

用于判断是否值得进入项目制方案,不代表标准 SKU 或固定报价。

HGX / 高互联平台,2TB ECC,高速 NVMe

T 系列 AI 训练服务器方案档

适合已有真实负载、现场环境和预算边界的项目,需要方案工程师介入。

HGX H200 / B200 级互联,IB 网络,集群软件栈,按项目确认

T 系列 AI 训练服务器验收档

适合进入正式项目评估,重点锁定供货周期、满载测试、现场条件和验收方式。

高端 AI 训练、科研平台、模型公司项目,需确认预算、供电、制冷、网络和交付周期

T 系列 AI 训练服务器技术规格

默认展示采购最常看的规格组,完整技术边界可展开查看。最终以报价单、供应情况和项目确认表为准。

型号页用于锁定平台方向,具体品牌、料号、尺寸、盘位、电源和认证项需要在报价单与项目确认表中二次确认。

处理器与平台

- CPU 选项

- 项目制高互联训练主机平台

- 平台体系

- 项目制平台

- 可选平台

- 高互联训练主机平台 / HGX 主机平台 / 按项目确认 CPU 版本

- 平台定位

- 高互联 AI 训练平台,面向 OAM / HGX / NVLink / NVSwitch 项目咨询,不等同普通 PCIe 8 GPU 节点

- 平台主板

- 项目制高互联 / 整柜 AI 平台,按厂商路线、机房条件和集群软件栈确认

- 芯片组/通道

- 训练服务器平台,重点确认 GPU 互联、PCIe/NVLink、网络和散热方案

- 系统环境

- Linux 为主,PyTorch / TensorFlow / CUDA / Slurm / Kubernetes 可选

内存与扩展

- 内存范围

- 2TB+ ECC

- 可选内存

- 2TB+ ECC

- 内存拓扑

- ECC 大内存,容量按模型规模、数据预处理和多用户训练规划

- 容量建议

- 建议 2TB+ ECC,按模型规模、数据管线和多机训练策略确认

- PCIe 扩展

- OAM / HGX 高互联拓扑,需确认 GPU 模组路线、CPU 平台、网络插卡、管理节点和供货窗口

GPU 与加速

- GPU 方向

- 8x OAM / HGX H200 / B200 级高互联 GPU,按项目确认

- 可选 GPU

- OAM GPU 项目确认 / HGX H200 项目确认 / HGX B200 项目确认 / NVLink / NVSwitch 拓扑确认

- 拓扑/数量

- OAM / HGX H200 / B200 级高互联项目方向,重点确认 NVLink/NVSwitch、NCCL 和集群拓扑

- 供电关注

- 训练 GPU 满载时间长,需同步核算机柜供电、散热、线缆和冗余策略

- 适配软件

- PyTorch / CUDA / NCCL / Slurm / Kubernetes

展开完整技术规格与交付边界

存储与数据

- 存储策略

- 高速 NVMe + InfiniBand / 集群存储

- 可选存储

- 高速 NVMe / InfiniBand / 集群存储接入

- 盘位/缓存

- 高速 NVMe + InfiniBand / 集群存储接入,按训练数据路径设计

- 数据分层

- 建议训练热数据落在本地 NVMe 或高速共享存储,冷数据进入容量层

- 保护策略

- 按实验数据、模型 checkpoint、日志和数据集版本规划备份策略

网络与管理

- 网络选项

- InfiniBand 或 400GbE 方向,按多机训练通信和存储访问拆分网络

- 远程管理

- 带外管理、CUDA/NCCL/容器/调度环境交付

- 安全策略

- 支持多用户实验环境、容器镜像、数据权限和内网训练平台策略

- 部署运维

- 可提供 CUDA/NCCL/驱动版本、容器镜像建议、训练环境交付说明和测试记录

机箱电源散热

- 机箱形态

- OAM / HGX 高互联 AI 训练服务器,机箱形态按 GPU 平台和项目方案确认

- 电源策略

- 高互联训练平台需结合机柜供电、液冷/风冷、PDU 和现场条件规划

- 散热验证

- 建议按机房制冷能力、液冷条件、GPU 平台要求和满载测试共同确认

- 部署环境

- 训练平台建议机房部署;高密度 GPU 需提前确认供电、制冷和承重

- 交付边界

- 项目制高互联 AI 训练平台

交付与支持

- 交付周期

- 项目评估后确认

- 满载验证

- 建议验证 NCCL、分布式训练样例、GPU 互联、IB/高速网络、集群调度和故障告警

- 交付资料

- 可提供 CUDA/NCCL/驱动版本、容器镜像建议、训练环境交付说明和测试记录

- 项目说明

- 具体品牌、料号、尺寸、盘位和电源型号以最终报价单与项目确认表为准

软件与工作流适配

不只看软件名称,更要看版本、插件、数据规模和团队使用方式。

训练和推理要确认显存、驱动/CUDA、容器镜像和数据读取路径。

交付时建议固化驱动、CUDA、NCCL 和测试样例。

建议结合实际项目文件、用户数量和交付环境进一步确认配置。

多机训练和科研平台需要把资源调度、账号和监控一起规划。

平台化部署要提前确认 GPU Operator、存储路径和监控策略。

部署边界与风险确认

高性能系统的风险通常不在单个参数,而在供电、散热、数据路径和交付环境。

确认高功率 GPU 供电、制冷、网络互联、数据路径和调度环境。

确认本地盘、项目盘、共享存储、备份和数据不落地要求。

交付前建议记录驱动版本、系统环境、满载测试和基础软件验证结果。

服务与交付验证

硬件交付不是结束,稳定运行和可维护性才是专业系统的重点。

交付前调优

按应用场景检查 BIOS、电源策略、驱动和散热曲线。

稳定性验证

针对持续负载、显卡温度、存储读写和系统日志做基础验证。

企业支持

支持售前方案、远程诊断、备件策略和项目制技术响应。

YRT Z5 V8 塔式工作站Z 系列塔式工作站与计算平台

YRT Z5 V8 塔式工作站Z 系列塔式工作站与计算平台 YRT Z7 V8 高端专业工作站Z 系列塔式工作站与计算平台

YRT Z7 V8 高端专业工作站Z 系列塔式工作站与计算平台